Your curated collection of saved posts and media

👀 GTC DEV COMMUNITY - JOIN US! 🧠 @NVIDIAAIDev Location: GTC Park Tues, 3/17 | 10 am–12 pm Live Agent Gauntlet 🤖 Location: GuildHouse Tues, 3/17 | 11 am–6 pm Hack for Impact 🦞 Weds, 3/18 | 9 am–2 pm Hack to Create 🎨 Thurs, 3/19 | 8 am–12 pm Vibe Hack 😎

GTC is days away. The developer events are piling up ❤️🤙

Steve Jobs literally predicted the iPhone, the Internet, AI and the next 50 years of technology in a single speech from 1983: https://t.co/DtwrMJBx1x

Steve Jobs was so far ahead.

@fender_belly @StolenDans strong first half

new ultimate bumper sticker arrived thanks to jason cryer at smile worldwide (all of his stickers are so good) https://t.co/QlYelVa47A

on a frontier airlines flight working class teacher reading zizek beside me having a convo with the flight attendant about it, two folks behind me work in retail and sales respectively and are talking about Mahler and Wagner. death of intellectual life pronounced too soon

@mcmansionhell 🥲

Attack of the 50 Foot Woman (1958) dir. Nathan Juran https://t.co/hiCjYETSQ7

they could never get the sequel where she fights Godzilla past the censors

@SpirosMargaris The AI hype cycle has completely hijacked technical language. “AI agents” are routinely described as having agency or intention when they have neither. A prompt isn’t the AI’s intention, it’s the operator’s. In this case, the hacker group. The system itself has no goals, autonomy, or independent motivation. From what’s described, this looks like a conventional security failure exploited with automation. That’s not new. Security tools have been automating discovery and exploitation paths for decades. Calling this “AI vs AI” cyberwarfare is marketing language, not technical analysis. These narratives don’t clarify what happened, they obscure it. What the industry and media actually need is better AI literacy, not more hype.

Openclaw vibes in China. Packed as usual. https://t.co/Ml6tSQOTve

Openclaw vibes in China. Packed as usual. https://t.co/Ml6tSQOTve

https://t.co/Qvqllzde6J

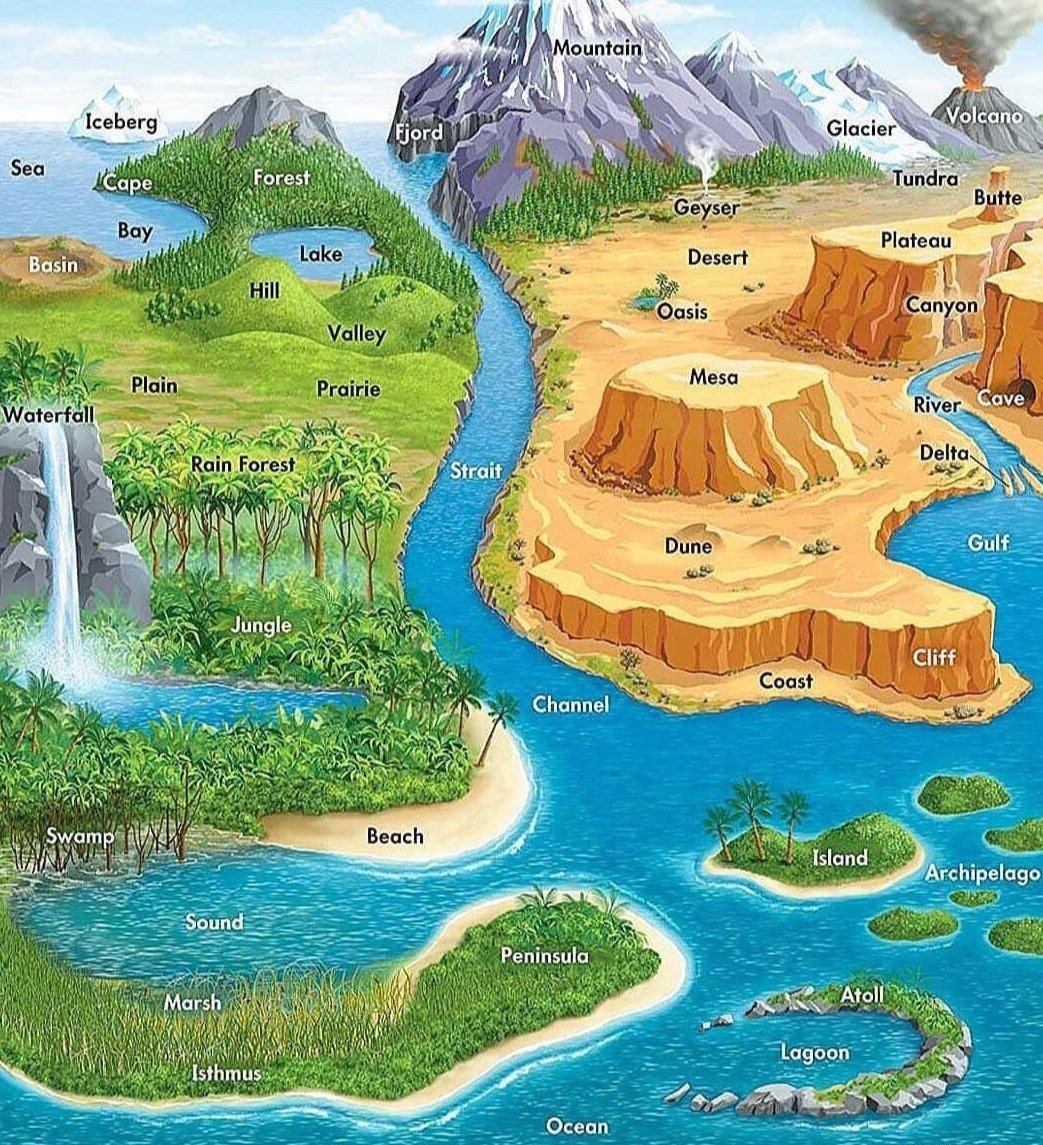

I've been practicing historically accurate remote viewing for the past 2 years, moving gradually backwards in time as my skills developed. Yesterday I attempted to remote view Eden. This is what I saw. https://t.co/1Kurk7vM3b

【Machine Learning Street Talk 出演のお知らせ】 Sakana AIのResearch Scientistである @RobertTLange が、機械学習分野の有名ポッドキャスト @MLStreetTalk に出演いたしました。 🎥動画本編:https://t.co/egnRSVRRim 進化的アルゴリズムとLLMを組み合わせたオープンソースのプログラム最適化 フレームワーク「ShinkaEvolve」やAI Scientistの現在地について、ホストのTimさんと語り合いました。 [ハイライト] 1.LLM駆動の進化的探索が実用段階に ポッドキャストでは、ShinkaEvolveの原理について詳しく解説しました。複数のフロンティアモデルをバンディットアルゴリズムで動的に選択し、3種の変異を使い分けます。これにより、ShinkaEvolveは円充填(circle packing)問題で150回未満のLLM呼び出しで最先端の解に到達しました。また、競技プログラミングの問題からなるALE-Benchでも高スコアに。こうした達成を背景に、Robertは「私たちは今、進化的LLMシステムが革新的な科学的発見をもたらせる変曲点にいる」と語っています。 2.「Problem Problem」― 次に超えるべき壁 一方でRobertは、次の課題についても言及しました。現在の手法は問題が所与であることを前提としていますが、人間の科学的営みでは問題そのものの再定義が発見の核心にあります。Robertはこれを「the problem problem」と呼び、問題と解の共進化を次のステップとして見据えています。 3.AIエージェント時代の研究者のあり方 Robertは、コーディングアシスタントへの依存について「薬物に頼っている気がすることもある」と率直に語る一方で、理想の未来像も明確に描いています。日中はシステムと協働し、夜間はシステムが自律的に実験を走らせ、朝に結果を確認する「マルチスレッド研究」。研究者は実行者ではなく操舵者になる。「実行はAIに任せ、分析は自分でやる」。AIは人間に取って代わるのではなく、人間に一日の長がある思考の潜在的な次元(latent dimension)を増幅してくれる存在としてAIがあるというのが彼の見立てです。 機械学習研究の多くの部分がAI支援のもとですでに行われており、ますます研究は「with AI」から「by AI」へ、そして研究エージェントの「人間による高次のオーケストレーション」へと移行しつつあります。 内容にご関心がある方は、ぜひ動画をご覧ください。Sakana AIは、この大変革の時代を先導する一員として、研究に引き続き取り組んでいきます。

【Machine Learning Street Talk 出演のお知らせ】 Sakana AIのResearch Scientistである @RobertTLange が、機械学習分野の有名ポッドキャスト @MLStreetTalk に出演いたしました。 🎥動画本編:https://t.co/egnRSVRRim 進化的アルゴリズムとLLMを組み合わせたオープンソースのプログラム最適化 フレームワーク「ShinkaEvolve」やAI Scientistの現在地について、ホストのTimさんと語り合いました。 [ハイライト] 1.LLM駆動の進化的探索が実用段階に ポッドキャストでは、ShinkaEvolveの原理について詳しく解説しました。複数のフロンティアモデルをバンディットアルゴリズムで動的に選択し、3種の変異を使い分けます。これにより、ShinkaEvolveは円充填(circle packing)問題で150回未満のLLM呼び出しで最先端の解に到達しました。また、競技プログラミングの問題からなるALE-Benchでも高スコアに。こうした達成を背景に、Robertは「私たちは今、進化的LLMシステムが革新的な科学的発見をもたらせる変曲点にいる」と語っています。 2.「Problem Problem」― 次に超えるべき壁 一方でRobertは、次の課題についても言及しました。現在の手法は問題が所与であることを前提としていますが、人間の科学的営みでは問題そのものの再定義が発見の核心にあります。Robertはこれを「the problem problem」と呼び、問題と解の共進化を次のステップとして見据えています。 3.AIエージェント時代の研究者のあり方 Robertは、コーディングアシスタントへの依存について「薬物に頼っている気がすることもある」と率直に語る一方で、理想の未来像も明確に描いています。日中はシステムと協働し、夜間はシステムが自律的に実験を走らせ、朝に結果を確認する「マルチスレッド研究」。研究者は実行者ではなく操舵者になる。「実行はAIに任せ、分析は自分でやる」。AIは人間に取って代わるのではなく、人間に一日の長がある思考の潜在的な次元(latent dimension)を増幅してくれる存在としてAIがあるというのが彼の見立てです。 機械学習研究の多くの部分がAI支援のもとですでに行われており、ますます研究は「with AI」から「by AI」へ、そして研究エージェントの「人間による高次のオーケストレーション」へと移行しつつあります。 内容にご関心がある方は、ぜひ動画をご覧ください。Sakana AIは、この大変革の時代を先導する一員として、研究に引き続き取り組んでいきます。

@CausalEngineer That's not a word

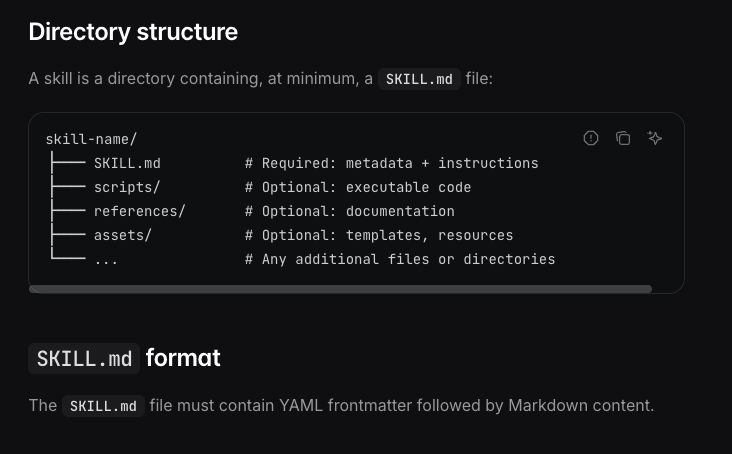

I will be doing a FREE live session on building and optimizing skills in a few days. I believe building Agent Skill is one of the most important skills you could learn today. https://t.co/1cPggXyv8N

There should be a word for this trait. Something like "selfmaking". You make your self by making things yourself.

The Chef Boyardee Culinary Institute

@bendee983 I got it from @math_rachel :)

I literally have an ongoing cancer experiment where 100% of the untreated and control animals have had to be euthanized while 100% of the treatment animals are seemingly unaffected. But we're still extremely far away from "proving that it works." Science is hard.

This is a really interesting thread. If we literally already have a cure for (some kinds of) cancer, but can't *prove* it's "safe and effective", should terminally ill patients have an option to use it anyway?