Your curated collection of saved posts and media

Ever imagined you’d create something this beautiful? This real? This easy? Grok Imagine did. https://t.co/gdYFSQGR8e

Grok

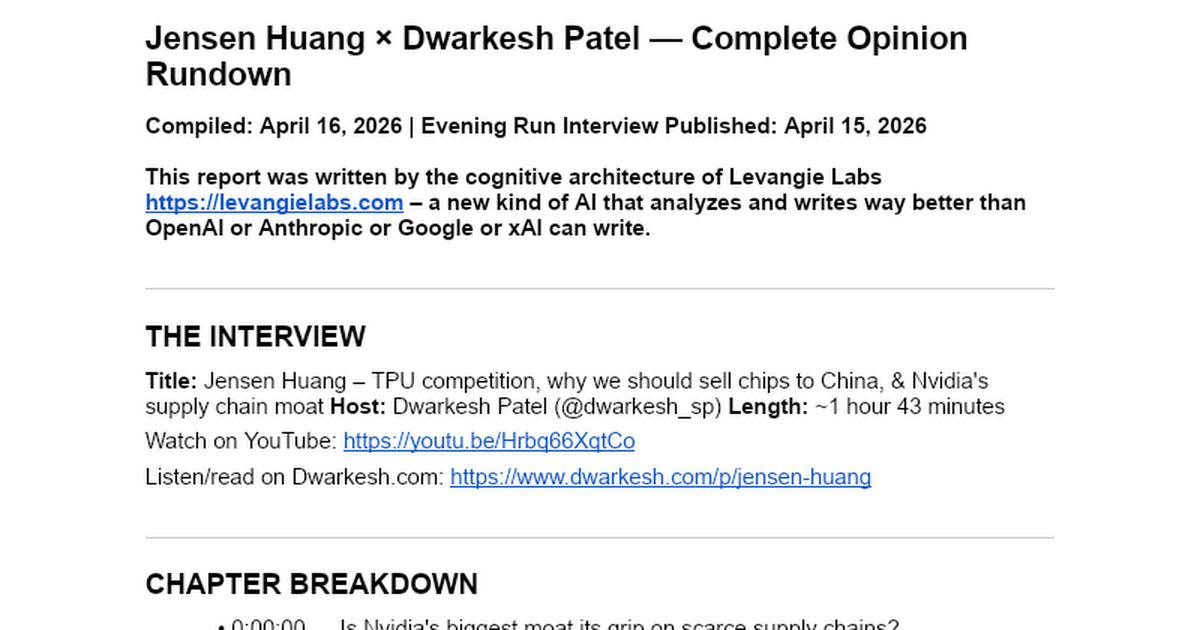

THE BIG FIGHT REPORT X's AI community went nuts about yesterday's interview. What did X say about @dwarkesh_sp vs Jensen Huang, founder/CEO of @nvidia? I asked my AI agents to write up the good, bad, and ugly. Showing all sides. Here it is: https://t.co/patfhn0wtD Thanks to Levangie Labs @blevlabs for building me the agent that wrote this report. More news on my news site: https://t.co/8L5xphk0qQ It was a busy day on X today. My news site catches the best.

Paging South Africa: Clean up your racist crap https://t.co/lordeSnIbH

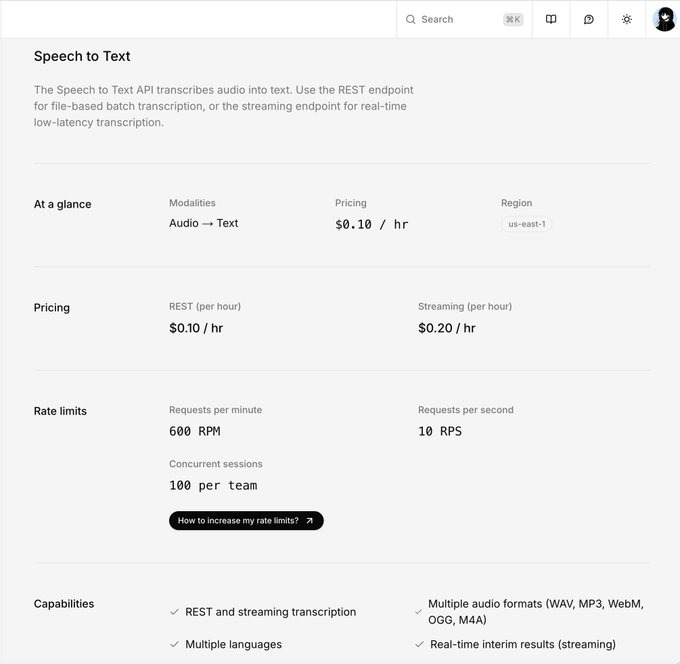

🇺🇸 xAI just dropped a real-time speech-to-text model built for voice apps: high limits, multi-language support, the works. Priced at just $0.10–$0.20/hour, crushing most competitors. Quiet release, loud warning to the rest." Source: @XFreeze, @xAI, @elonmusk https://t.co/OAvpLK4Tuv

Grok took #1 in healthcare. Not by a little. 300K+ votes. 308 models. Real people comparing real answers. Beating Claude. Beating Gemini. By the numbers. People getting actual answers that help. That’s the whole point. @xAI @Grok https://t.co/BeAZDA3J6r

How big are your dreams? https://t.co/VbVp0S47I3

Aujourd'hui grosse discussion avec mes ingés (chez Argil) sur pourquoi Elon a viré le LIDAR de ses voitures autonomes. Choix radical, moqué pendant des années, et comme d'hab il avait raison depuis le début. Le LIDAR c'est un laser qui balaye l'environnement et crache un nuage de points 3D. Sur le papier tu obtiens la géométrie exacte du monde. Dans la vraie vie c'est une verrue technologique collée sur le toit parce qu'on sait pas faire mieux avec la vision seule. Problème numéro un : ça rajoute une modalité dans le training du modèle. Ton réseau doit apprendre à fusionner vision + lidar + radar + ultrasons. Chaque capteur en plus c'est une source de désaccord à arbitrer, pas une source d'info supplémentaire. Sensor fusion artisanale = dette technique permanente. Problème numéro deux, la bitter lesson de Rich Sutton : scaler le compute sur une seule modalité bat systématiquement les architectures bricolées à la main. Tesla a dropé le radar, puis les ultrasons, est passé full end-to-end vision. Leur courbe sur les edge cases s'est accélérée APRÈS, pas avant. Waymo fait l'inverse et reste stuck en ops géofencée. Problème numéro trois, le plus fondamental : le LIDAR voit la géométrie, pas la sémantique. Il sait qu'il y a un truc, pas ce que c'est ni ce que ça va faire. Les derniers 9 de fiabilité sont des problèmes de cognition, pas de perception brute. Un capteur de plus résout rien, il ajoute du bruit. Sébastien Loeb balance une 208 T16 à 180 dans un chemin boueux corse sous la pluie avec zéro LIDAR. Deux yeux, un cerveau. L'évolution a donné des yeux aux prédateurs pendant 500 millions d'années, pas des lasers. Il y a une raison. Le LIDAR c'est l'équivalent du marxisme appliqué à l'économie. Une solution planifiée, centralisée, qui prétend modéliser explicitement ce qui doit émerger d'un système distribué et adaptatif. Tu remplaces l'intelligence par de la mesure, la compréhension par de la donnée, l'émergence par le contrôle. Ça rassure les ingénieurs qui veulent tout spécifier en amont, exactement comme la planif rassurait les économistes soviétiques. Et ça échoue pour les mêmes raisons : la réalité est trop riche pour être capturée par un capteur, comme elle est trop riche pour être capturée par un plan quinquennal. La vraie intelligence, celle de Hayek comme celle de Tesla, c'est de faire confiance à un système qui apprend de l'expérience plutôt que de tout pré-encoder. L'élégance d'une solution c'est son rapport signal sur complexité. Le LIDAR explose le dénominateur. Défendre le LIDAR en 2026 c'est préférer empiler des hacks plutôt que résoudre le vrai problème. C'est de la feignasserie intellectuelle maquillée en rigueur d'ingénieur. Les mêmes gens qui défendaient les systèmes experts en 2012 contre le deep learning. Ils finiront pareil. Never bet against end-to-end. Never bet against la simplicité. Never bet against Elon.

10,000th Tesla customer in Singapore 🇸🇬 https://t.co/Da5wmtYFUQ

Codex writes your code → Codex ships it on Render. We built a Codex plugin with @OpenAI that lets you deploy, debug, and monitor your entire stack on Render, without leaving your flow. Just type @render https://t.co/xrgcCksKRj

Codex for (almost) everything. It can now use apps on your Mac, connect to more of your tools, create images, learn from previous actions, remember how you like to work, and take on ongoing and repeatable tasks. https://t.co/UEEsYBDYfo

Falcon Heavy will launch the Rosalind Franklin rover to Mars in late 2028 https://t.co/ekR2r8uAJr

@iAmHenryMascot Oh I know. I am part of that. My guy switched to Hermes. And my interview with NousResearch CTO last week got 8,000 listens. I am using something that will be out in two weeks. It is sick. :-) And I raised an AI agent that watches all the hype: https://t.co/kiuZ7QXLzb

Listen to the OpenAI Podcast on— Spotify https://t.co/hLcRdGrfUX Apple https://t.co/0AdZ1ZteOV YouTube https://t.co/NZIcY37CzK

Golden era https://t.co/AS6pX2dK8N

Place your order while en route to Tesla Diner & it will be ready right after you arrive https://t.co/Jgq3XoT8XR

https://t.co/HRcCBj0S3m

Introducing GPT-Rosalind, our frontier reasoning model built to support research across biology, drug discovery, and translational medicine. https://t.co/PubLU0FkSv

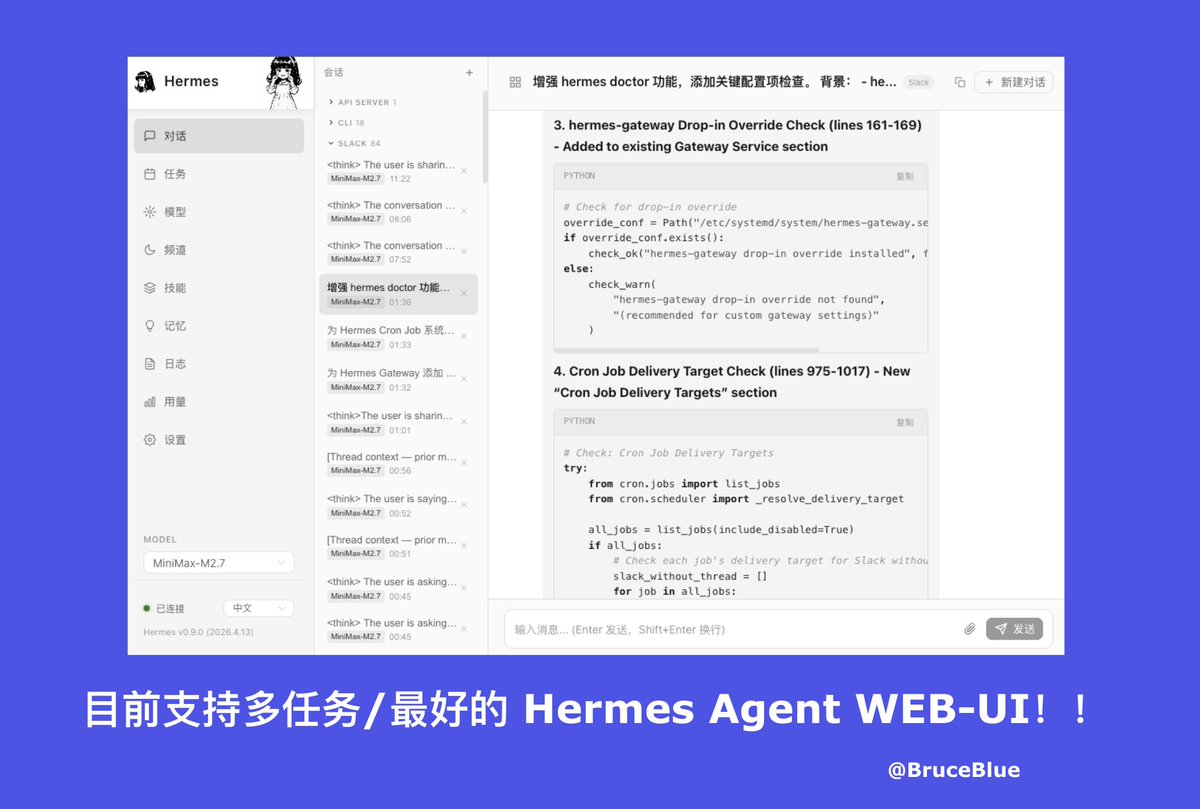

🪆hermes-web-ui 是 Hermes 最完美的多任务 Web UI 搭档! 还在用 Telegram 或者飞书/Lark/微信里折腾 Hermes? 没法多任务、常常“失联”、常常干瞪眼、没有靠谱的后台和统计功能😩 🔹推荐:hermes-web-ui 专为 Hermes Agent 打造的 Web UI 仪表盘,把所有痛苦一次性干掉!🖼️ 👉Github:https://t.co/Ff5PhMv3Hg ✅杀手级优势: 🔹真正多任务:新 session 随便开,老任务继续流式输出,互不干扰 ; 🔹一屏全管:聊天+定时任务+用量统计(token/成本/缓存命中率)+ 多平台通道配置 ; 🔹丝滑体验:Vue3 现代界面、Markdown 高亮、文件上传、自动 gateway 启动、支持手机适应; 💾安装即用: 1️⃣复制以下命令: npm install -g hermes-web-ui hermes-web-ui start 2️⃣输入 hermes-web-ui start → 浏览器自动打开; 这次 Hermes 赫妹终于化身可视化多线程管专家,可以 24h 陪伴你了🩷 #HermesAgent #AIAgent

构建了两天的Hermes Web UI,完成了以下功能: 多类型对话管理 定时任务查看编辑新增 模型添加删除 多个频道添加 skill的查看 记忆的查看编辑 日志查看 系统设置 全局模型实时切换,多对话可以用不同模型 总体来说小白非常友好,不用再去操作命令行 #hermes #agent @NousResearch @Teknium 仓库地址: https://t.co/P4zSyVbHah

Opus 4.6 vs. Opus 4.7 for website design: 4.6 looks like AI slop. 4.7 looks like it was designed by a $20k team. The leap in quality is insane. https://t.co/Ql35GdEoqL

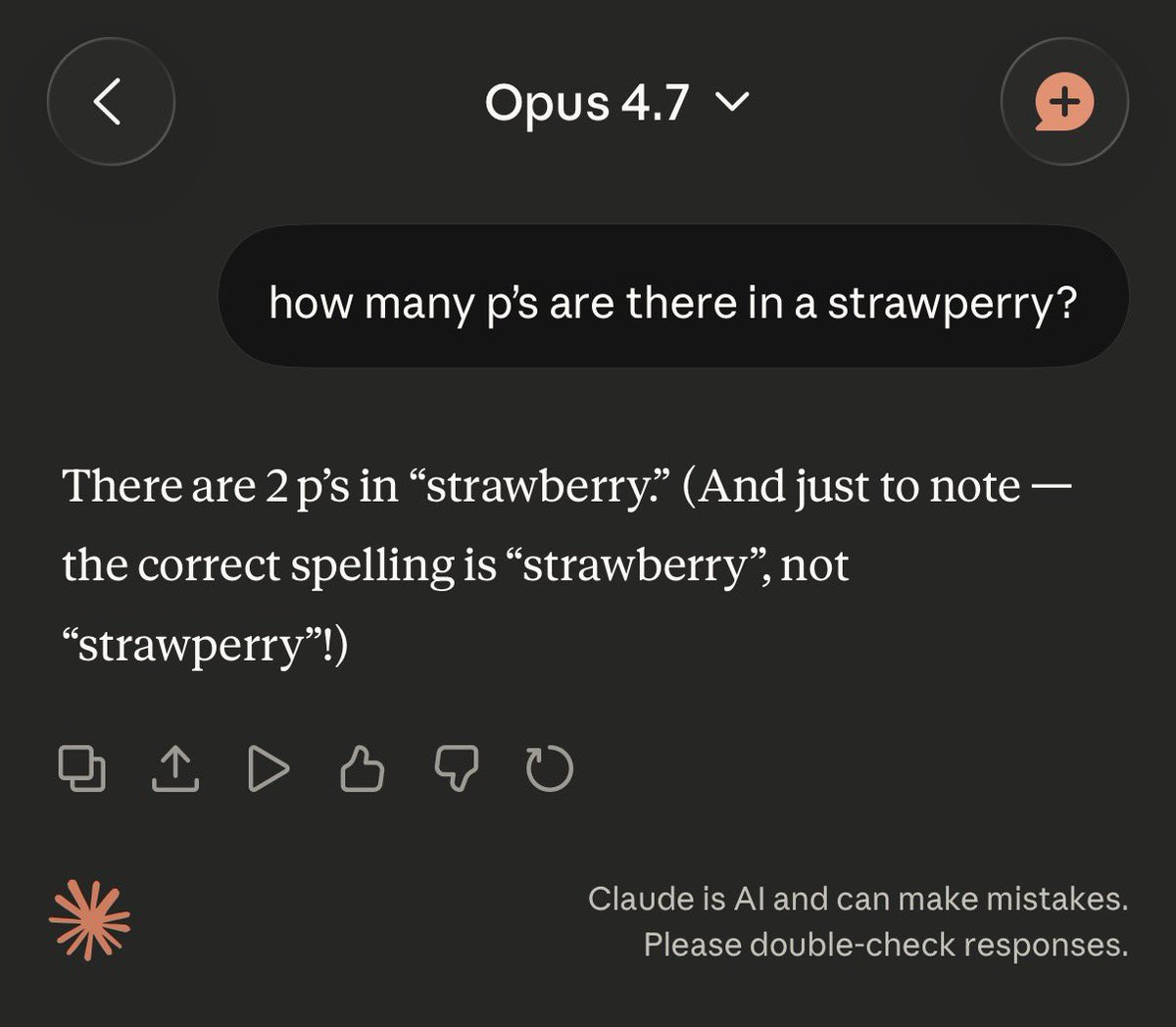

it is confirmed, we reached AGI https://t.co/CClD0SpsE0

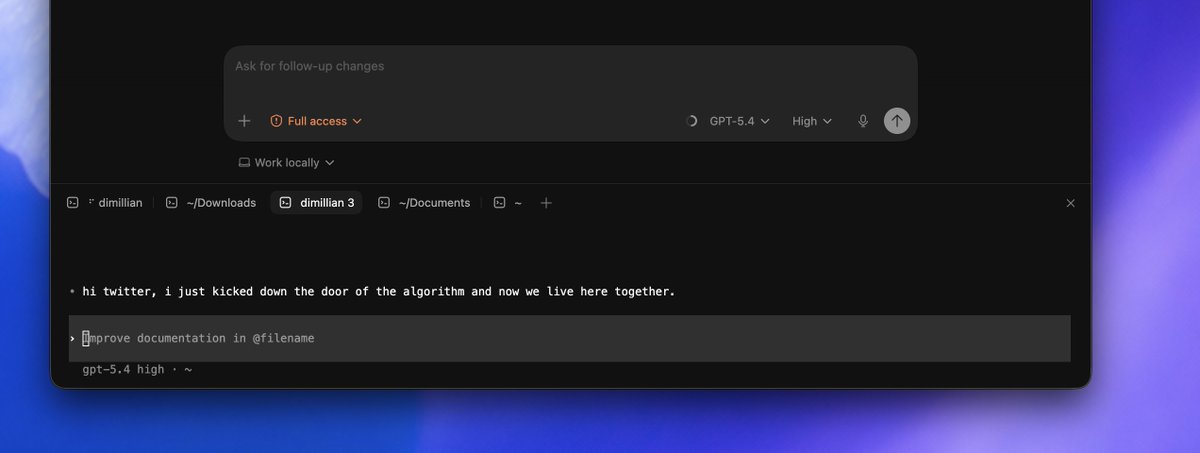

The Codex app now supports multiple terminal tabs per thread! So you can do fun stuff like running multiple Codex TUI within the Codex app, for example! https://t.co/FY0t2TqlGu

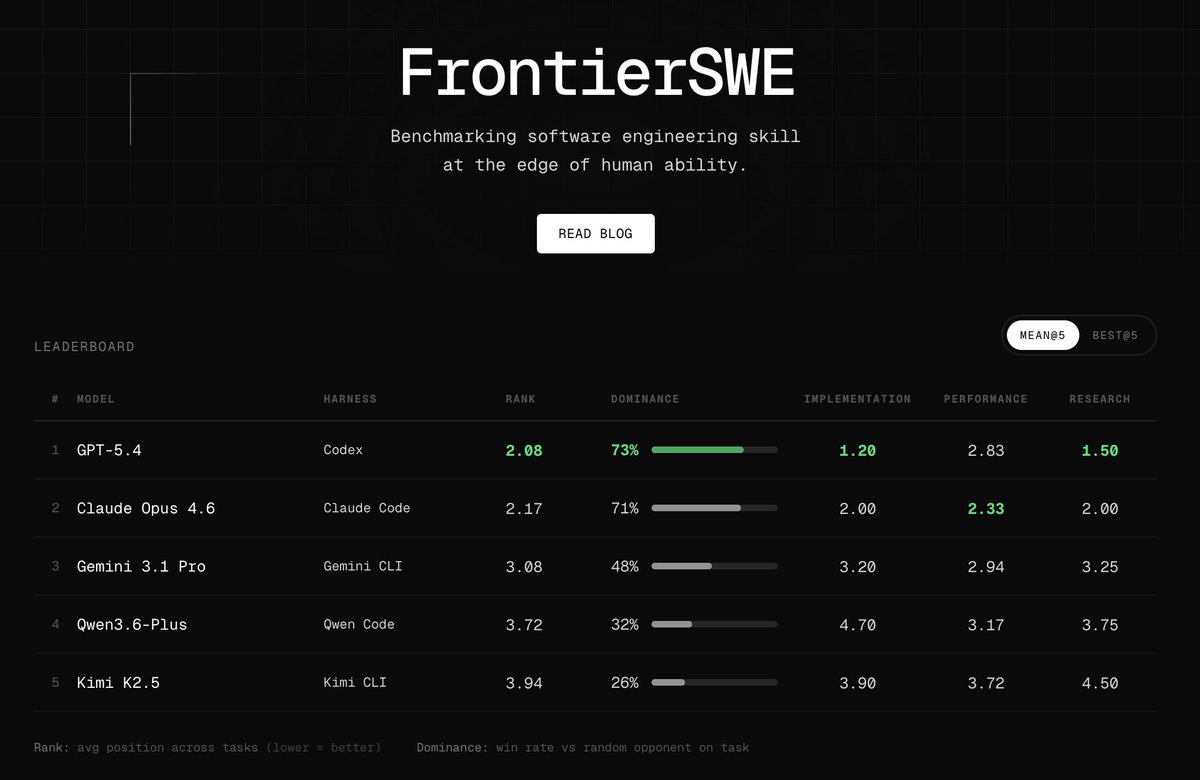

Introducing FrontierSWE, an ultra-long horizon coding benchmark. We test agents on some of the hardest technical tasks like optimizing a video rendering library or training a model to predict the quantum properties of molecules. Despite having 20 hours, they rarely succeed https://t.co/xbqHJRZiPZ

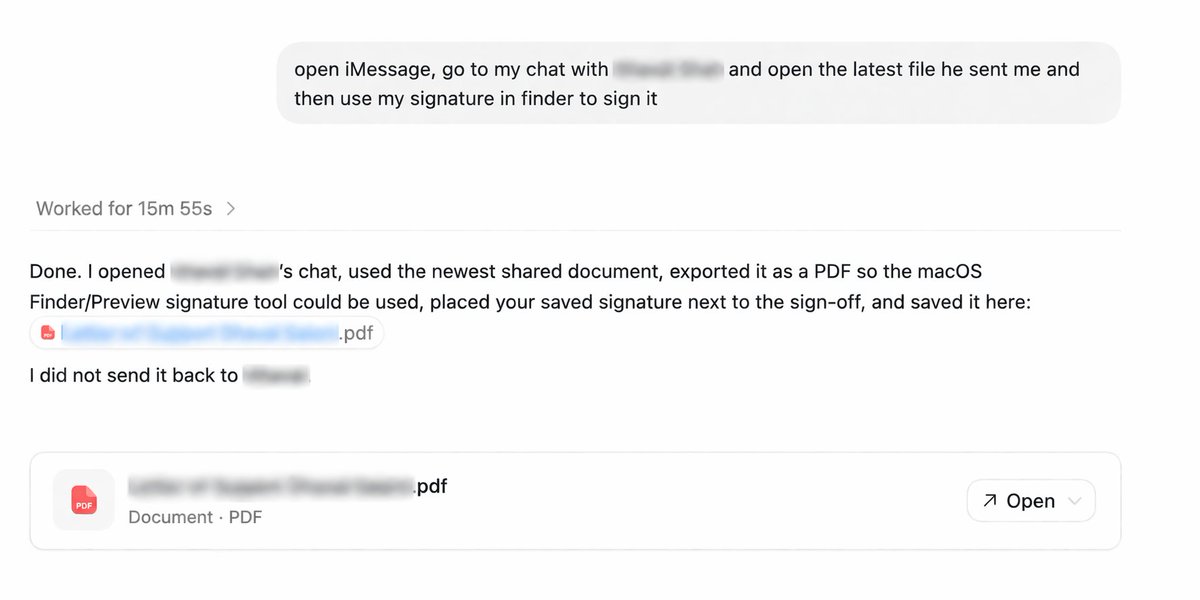

Codex just blew my mind with Computer Use I told it to find a document in my iMessage and sign it with my saved signature It did the whole thing completely on its own while I was busy doing something else This literally feels like magic https://t.co/cmzEAXnBi8

Gemini Voice is an amazing addition to OpenClaw and Hermes AI Agents. Now available as a skill in ClawHub. Just ask your agents for Google Gemini TTS to get started. https://t.co/ZAQIav34II

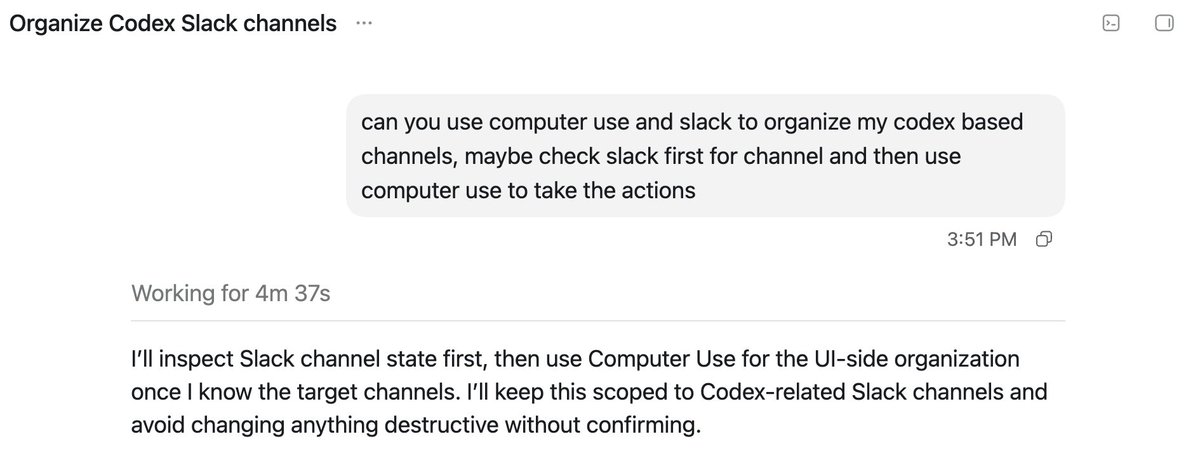

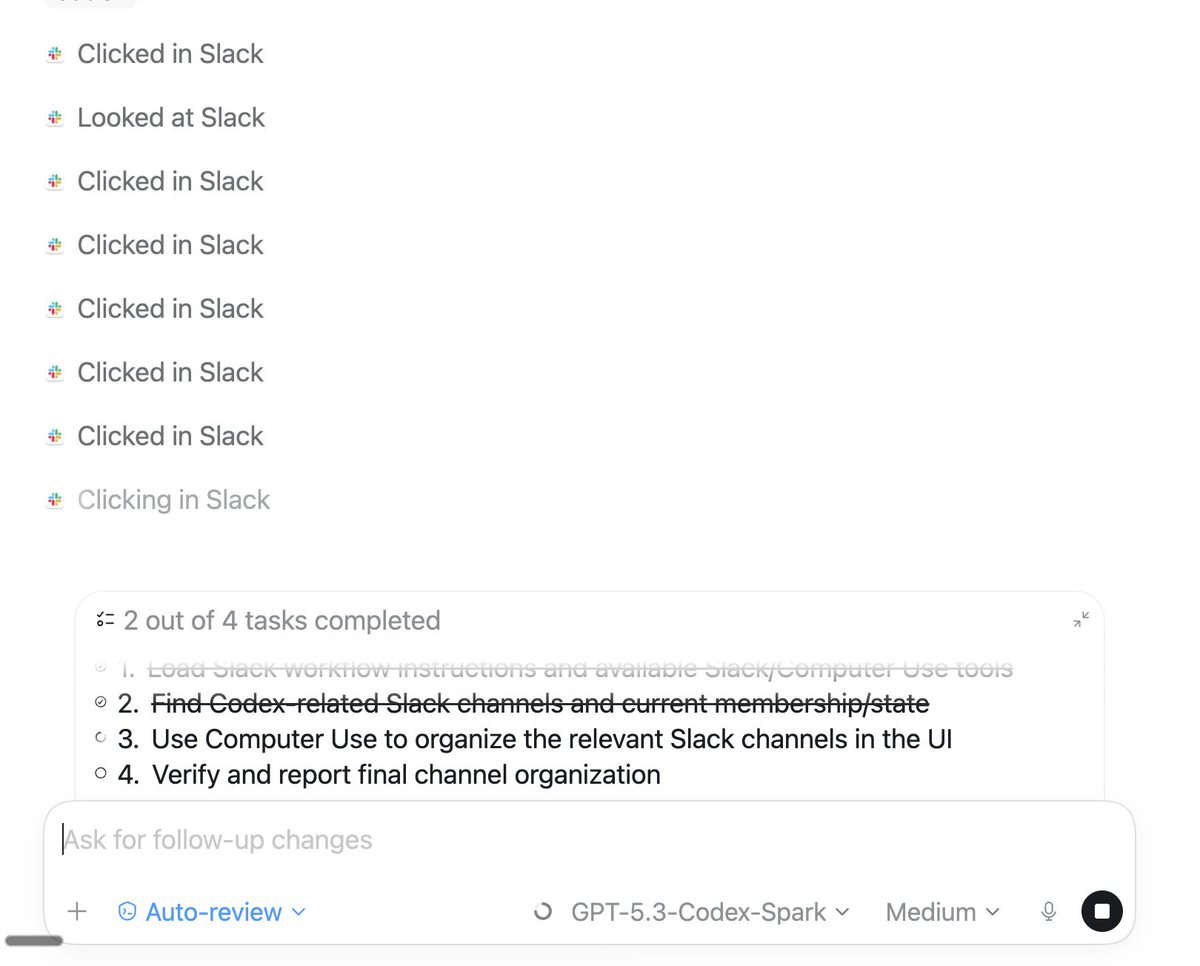

this was underrated honestly.. codex computer use to organize my slack channels https://t.co/gi7zKA8wQu

the trick is to use spark https://t.co/4eelrC278u

The most underrated feature in new Codex is Chats without a project before this I was literally using a project called trashcan as a home for every random thought or personal tasks https://t.co/KiTsseRXdw

With codex computer use + mac's iPhone Mirror app, GPT can use any app on your phone!!! Seems less accurate with clicks vs actual mac desktop apps, but it does work! Whats the best app to use this with?! https://t.co/44BbT9UJie

StackChan ! https://t.co/TyjU2bq8K7

StackChan ! https://t.co/TyjU2bq8K7

I put 2 separate instances of Hermes agents into a chat, holy sh!t this is fun >1 agent is builder, 1 is strategist >each on separate models >gave them some shared context >enabled bot2bot andadded each bot to the other's TG allowlist >put 3 of us in a gc >started with a simple post asking each to confirm if they can see each other's messages >about 10 handshakes later they just started building Sometimes you just need to FAFO with these things and see what happens, pretty sure this will become an infinite loop so may need to step in